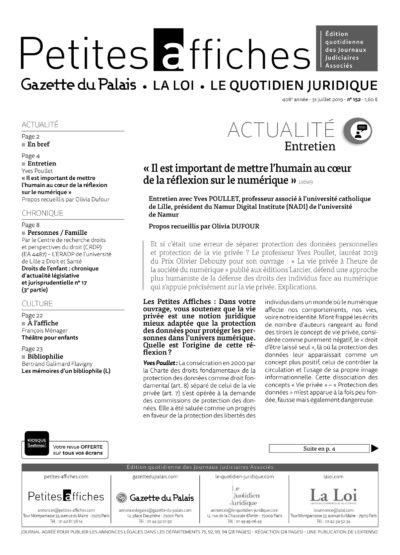

« Il est important de mettre l’humain au cœur de la réflexion sur le numérique »

Et si c’était une erreur de séparer protection des données personnelles et protection de la vie privée ? Le professeur Yves Poullet, lauréat 2019 du Prix Olivier Debouzy pour son ouvrage : « La vie privée à l’heure de la société du numérique » publié aux éditions Larcier, défend une approche plus humaniste de la défense des droits des individus face au numérique qui s’appuie précisément sur la vie privée. Explications.

Les Petites Affiches

Dans votre ouvrage, vous soutenez que la vie privée est une notion juridique mieux adaptée que la protection des données pour protéger les personnes dans l’univers numérique. Quelle est l’origine de cette réflexion ?

Yves Poullet

La consécration en 2000 par la Charte des droits fondamentaux de la protection des données comme droit fondamental (art. 8) séparé de celui de la vie privée (art. 7) s’est opérée à la demande des commissions de protection des données. Elle a été saluée comme un progrès en faveur de la protection des libertés des individus dans un monde où le numérique affecte nos comportements, nos vies, voire notre identité. M’ont frappé les écrits de nombre d’auteurs rangeant au fond des tiroirs le concept de vie privée, considérée comme purement négatif, le « droit d’être laissé seul », là où la protection des données leur apparaissait comme un concept plus positif, celui de contrôler la circulation et l’usage de sa propre image informationnelle. Cette dissociation des concepts « Vie privée » – « Protection des données » m’est apparue à la fois peu fondée, fausse mais également dangereuse.

LPA

En quoi la dissociation entre vie privée et protection des données est-elle « peu fondée » ?

Y.P.

S’il est vrai que le concept de vie privée a été lié historiquement à celui de l’intimité (de la maison, du cercle familial, des communications) et que les termes « vie privée » sont à l’évidence mal choisis et évoquent cette approche négative, l’interprétation hardie que la Cour strasbourgeoise a donné à l’article 8 de la Convention EDH, élargit considérablement la signification du concept. Pour reprendre la formule de l’arrêt Pretty, la vie privée a pour but de garantir l’autodétermination et l’arrêt Barbalescu voit dans la vie privée, la capacité de « forger sa propre identité ». Ainsi, au hasard des cas jugés par la Cour, la vie privée, c’est désormais le droit de connaître ses origines, de connaître les risques liés au choix de son domicile, d’entrer en communication avec des tiers depuis le lieu de son travail, etc. Bref, le concept de vie privée rassemble désormais l’ensemble des garanties nécessaires au développement de la personnalité de chacun. En ce sens, ce concept peut se rapprocher de celui de « capabilities » cher à Amartya Sen, Prix Nobel de l’économie qui assigne à l’État, en fonction du contexte dans lequel il évolue, la mission d’offrir à chacun la chance de son épanouissement. Notons que cet épanouissement personnel exige à la fois le droit de la personne de se retirer en elle-même (le droit à l’intimité) mais également d’aller en confiance vers autrui et de participer pleinement à la vie sociale (le droit à l’inclusion). « Vie privée-intimité » et « vie privée-autodétermination », constituent donc les deux faces indissociables d’un même concept.

LPA

Vous allez plus loin en affirmant qu’elle est fausse et dangereuse, pourquoi ?

Y.P.

Les législations de protection des données à caractère personnel ne constituent à mon sens qu’une exigence déduite des obligations positives que la Convention européenne impose aux États afin de garantir l’effectivité des droits de l’Homme, et en particulier de la vie privée. Que voulons nous dire ? C’est en réaction aux risques créés par le numérique, certes souvent invisibles mais bien réels (risque d’être réduit à ses données (« datafication » des personnes), risque de manipulation, de stigmatisation, de discrimination, de surveillance permanente…, que les législations de protection des données ont été mises sur pied et régulièrement revues. Avec le RGPD, nous en sommes à la troisième génération. Cette révision est nécessaire en fonction de l’accroissement des risques rencontrés par nos libertés voire notre identité et, au-delà, par nos démocraties. Le droit à la protection des données n’est donc jamais qu’un « moyen » d’assurer notre épanouissement, un droit-dérivé de la vie privée. Le mettre sur le même pied que ce dernier lui fait perdre son sens, son âme, à savoir veiller à garantir que le numérique et ses applications infinies servent au développement de la dignité et des libertés des individus. Séparer les deux concepts m’apparaît également dangereux. La première raison est de priver le droit de la protection des données de son sens et donc du moteur de l’évolution de sa réglementation. La seconde est que les juges de la Cour de Luxembourg, dans le futur, ne se réfèrent plus à l’élargissement heureux opéré par la Cour de Strasbourg du concept de vie privée. Ce risque n’est pas présent à l’heure actuelle : les décisions de la CJUE intervenues depuis l’adoption de la distinction Vie privée – Protection des données, mêlent en effet dans leurs références indistinctement les deux articles 7 et 8, ce qui témoigne sinon de leur volonté de conserver ces deux droits indissociables, au moins de la difficulté de les dissocier. Ne peut-on cependant craindre une rupture à un moment donné des jurisprudences des deux cours ?

LPA

En quoi la vie privée peut-elle renforcer la protection des personnes ?

Y.P.

La référence à l’épanouissement permet d’élargir et de faire évoluer le débat et de contribuer ainsi à une meilleure protection, non de l’individu isolé, mais de l’humain comme être social qui doit contribuer au débat démocratique. Prenons les débats sur l’intelligence artificielle (IA) et en particulier les méthodes de « deep learning ». Premièrement, ces débats témoignent à l’évidence des limites du RGPD, malgré toutes les vertus que je lui prête. Ainsi, l’approche « données à caractère personnel » tourne court lorsqu’on sait que les mégadonnées, qui nourrissent les corrélations, mélangent allègrement des données anonymes avec les données à caractère personnel ; on s’interroge sur le respect par ces systèmes d’IA des principes de proportionnalité et de finalité déterminés pourtant comme centraux dans le règlement. Et comment parler d’obligation d’information des personnes concernées relatives à la logique du traitement, lorsque les décisions se fondent sur des corrélations et non une logique causale, en outre sans nécessairement être transparentes même pour les concepteurs de ces systèmes ? En deuxième lieu, là où le RGPD n’évoque que la responsabilité des « responsables de traitement », le fonctionnement et le design des outils de collecte et de traitement d’informations, par exemple les robots, renvoient à la nécessité de conférer au producteur, au concepteur ou aux intégrateurs de systèmes d’information une responsabilité. Troisièmement, l’utilisation des tels systèmes d’intelligence artificielle soulève des débats de société et éthiques. Cambridge Analytica témoigne de l’impact possible des techniques de profilage sur la démocratie ; le profilage commercial renvoie à des questions non tant de libertés individuelles que de discrimination et de justice sociale. L’utilisation de technologies qui permettent d’accroître les performances du cerveau voire modifient nos bagages génomiques requiert des débats éthiques tant sur la justice sociale que sur l’identité humaine. C’est à ces débats, fondamentaux dans un contexte technologique imprédictible et toujours en mouvement, qu’invite la question de la vie privée, c’est-à-dire de l’épanouissement humain.

LPA

Le consentement qui fonde en partie la démarche du RGPD vous semble-t-il être une notion adaptée pour protéger les personnes contre les géants d’internet ?

Y.P.

Le consentement est la première cause de légitimité. Cette affirmation apparaît logique dans la mesure où l’approche individualiste de nos législations de protection des données amène à concevoir la personne comme « maître » (j’allais dire « propriétaire ») de « ses » données et étant la mieux placé pour décider de leur utilisation. Le RGPD multiplie les qualificatifs qui permettent de valider ce consentement comme cause de traitement : il doit être libre, spécifique, informé et univoque, comme si cette multiplication garantissait une protection de la personne concernée. Il est même rétractable. De telles précautions ne sont dans la réalité qu’illusion. Le caractère instantané des opérations, leur caractère nécessaire ou rendu nécessaire par la pression sociale de certains services, services par ailleurs offerts parfois soi-disant « gratuitement », conduisent l’internaute, même informé des risques, à donner son consentement à tout prix, sans s’arrêter aux risques qu’il prend de ce fait. La complexité des réseaux, l’opacité des traitements, la dissymétrie des pouvoirs informationnels entre les contractants rendent inopérante la protection offerte par le consentement.

LPA

Si le consentement est inopérant, de quelle autre solution disposons-nous ?

Y.P.

Ne faut-il pas, en particulier pour des services à considérer comme de première nécessité pour la vie sociale des individus prévoir leur réglementation d’office ou la nécessité pour les offreurs de tels services de négocier avec les représentants des internautes aidés ou non par l’autorité de contrôle ? Le consentement ne constitue-t-il pas en définitive qu’une protection en trompe-l’œil ? Autre question plus délicate : le consentement suffit-il à justifier la légitimité et la proportionnalité du traitement ? Il en constitue en tout cas une forte présomption. Cette règle nous apparaît dangereuse dans la mesure où la « négociation » bilatérale exclut toute réflexion sur les enjeux collectifs des traitements de données à caractère personnel. L’utilisation des mégadonnées pouvant porter atteinte non seulement à la vie privée et à la protection des données de façon individuelle, mais également à la dimension collective de ces droits, les politiques préventives et l’évaluation des risques doivent tenir compte de l’impact juridique, social et éthique de cette utilisation, y compris au regard du droit à l’égalité de traitement et à la non-discrimination. Quelques exemples : peut-on admettre que via la multiplication d’assurances one-to-one acceptées par les clients, on remette en cause le principe de mutualisation des assurances ? Un traitement consenti qui enregistrerait tous mes déplacements aux fins de surveillance est-il légitime au regard du principe de dignité humaine ? Puis-je autoriser que sur la base du suivi de mes habitudes de navigation et de mes transactions sur le net une société, comme Amazon l’a pratiqué, fixe le prix de ses services et de ses produits en fonction de mes supposées capacités d’achat et de l’élasticité supposée de ma demande pour le service et le produit spécifique ? Puis-je admettre que la prime d’une assurance santé soit diminuée à condition que j’accepte de porter jour et nuit un bracelet indiquant à tout moment des paramètres importants de mon état de santé ? Il y a là des questions de justice sociale et de non-discrimination qui transcendent le seul jugement individuel que traduit le consentement.

LPA

Vous préconisez la définition d’un nouveau droit, celui de la protection de la « maison virtuelle », qu’en est-il exactement ?

Y.P.

Le développement du numérique et la nécessité d’une maîtrise des outils mis à notre disposition doivent entraîner la reconnaissance de droits subjectifs nouveaux pour la personne concernée. On évoque sans le développer ici le droit à la déconnexion de l’équipement terminal qui nous apparaît une prérogative indispensable pour chacun de nous afin de nous permettre d’échapper à la surveillance et à la localisation permanente. Le droit à la protection de la « maison virtuelle » est un autre droit subjectif dont je réclame la consécration. Sur le modèle du droit à la protection du domicile privé, il permettrait au possesseur d’un terminal de rejeter toute intrusion, qu’il s’agisse de son micro-ordinateur, de son mobile, de sa puce RFID. Le terminal serait ainsi un lieu privé d’où autrui doit pouvoir être exclu. Deux mots sur le jugement allemand auquel je me réfère dans l’ouvrage. Saisi du recours d’une personne suspectée d’une infraction légère contre les autorités policières qui avaient introduit dans son ordinateur un logiciel espion afin de suivre les activités de ce suspect, la Cour constitutionnelle a condamné, le 27 février 2008, les pratiques policières de recherche on line via des chevaux de Troie. Elle affirme le droit fondamental à la garantie à la sécurité et à l’intégrité de ses systèmes techniques d’informations (« Grundrecht auf Gewährleistung der Vertraulichkeit und Integrität informationstechnischer Systeme »). Ainsi, l’intrusion non consentie, dans la puce d’un RFID ou d’un mobile, d’un logiciel pouvant à tout moment révéler notre localisation doit être interdite. On ajoute que l’article 5.3 de l’actuelle directive e-Privacy conforte le raisonnement. Cet article prohibe « l’utilisation de capacités de traitement ou de stockage d’informations d’un équipement terminal (par exemple cookies en provenance de tiers ou accès à des images stockées sur un mobile) et la collecte d’informations en provenance de ce terminal ».

LPA

Les personnes morales ont-elles une vie privée ?

Y.P.

Le débat relatif à l’extension des législations de protection des données aux personnes morales est ancien et j’ai souhaité le réanimer mais peut-être pas dans le sens auquel vous pensez. Lors de mes premières réflexions en la matière en 1979, j’avais été frappé par le fait que des législations de protection des données dites de première génération, en particulier, celles norvégiennes, luxembourgeoises et autrichiennes, protégeaient les personnes morales à l’égal des individus. L’argument avancé alors par une certaine doctrine était souvent que les personnes morales avaient une vie privée et on pourrait voir dans la consécration par l’UE du secret d’affaires une confirmation de cette thèse. Je ne suis pas séduit par l’argument : la consécration d’un droit de propriété intellectuelle sui generis qui défend les intérêts concurrentiels de l’entreprise a peu à voir avec la défense des libertés individuelles. En revanche, j’estime que la liberté d’entreprendre – autre droit fondamental consacré par la Charte – est mis à mal par la dissymétrie d’informations qui actuellement caractérise le marché de l’information. Certaines plates-formes, certains opérateurs de services d’information, les banques, les assureurs disposent grâce au numérique d’outils puissants y compris d’IA capables de prédire l’avenir d’une entreprise ou d’une filiale voire de les condamner à travers des rankings négatifs. Protéger, en particulier les entreprises petites et moyennes, contre ces traitements m’apparaît nécessaire, en ce compris pour les travailleurs y occupés et les territoires où ces entreprises sont installées. Affirmant cela, je ne prône pas l’extension du RGPD aux personnes morales – il y va d’une autre logique plus proche du droit de la concurrence que des droits du citoyen –, mais ceci dit, que des droits subjectifs d’accès, de rectification, d’effacement copiés de ceux conférés aux individus soient octroyés aux personnes morales dans le cadre d’une législation spécifique serait utile voire nécessaire à l’heure des prédictions de l’IA.

LPA

Votre démarche semble s’inscrire dans un courant humaniste qui vous rapproche de penseurs comme Alain Supiot…

Y.P.

Une telle référence m’honore même si je n’ai découvert la pensée féconde de l’auteur de l’Homo Juridicus, qu’après l’écriture de l’ouvrage, de même que celle du philosophe Éric Sadin, peut-être un peu trop manichéen et Cassandre à mon goût. À la suite de ces deux auteurs et d’autres auteurs américains de la vie privée comme Joshua Cohen ou mon ami Joel Reidenberg, je pense qu’il est important de mettre l’humain au cœur de la réflexion sur le numérique et de lui rendre la maîtrise du développement de cette technologie, comme le réclamait déjà Jacques Ellul. Tour à tour, les réflexions proposées dans l’ouvrage dessinent le paysage inquiétant d’une technologie foisonnante et révolutionnaire, dont la société aurait perdu la maîtrise et, en même temps, elles ne peuvent rejeter une pensée plus positive : le développement de ces technologies renvoie également à la promesse d’un homme libéré de nombre de contraintes et capable de dessiner son futur. Faut-il dès lors sombrer dans le pessimisme ambiant ou, au contraire, se réjouir de voir notre environnement, nos villes, nous-mêmes devenir plus intelligents, intelligence « artificielle » aidant ? Ce qui en tout cas est sûr, c’est qu’il nous faut faire preuve de « résilience », cette vertu qui, face à un défi, nous invite à réagir certes mais d’abord à réfléchir, réfléchir sur le sens que nous souhaitons donner à notre action et, de manière cohérente et décidée, d’agir ensuite avec autrui sur les choix de notre société. La réflexion et l’engagement éthiques doivent nous guider sans dogmatisme mais avec pragmatisme, confrontés avec des réalisations concrètes et plongeant dans des dialogues à multiples voix disciplinaires. Ils interdisent de concevoir nos échanges dans cette société du numérique, comme simplement marqués au coin de valeurs économiques et d’aborder le fait du numérique dans une perspective purement individualiste et utilitariste tantôt de protection et tantôt de valorisation de « nos » données personnelles. Telle est bien ma crainte aujourd’hui face à l’évolution de l’interprétation de nos législations de protection de données. L’adoption du RGPD ne peut signifier la clôture du débat juridique ; au contraire, nous sommes invités, face à l’innovation galopante des technologies du numérique, à lire et relire les droits de l’Homme et à leur donner plein sens.